Terwijl technologiebedrijven als OpenAI, Google en Microsoft de AI-markt domineren, onderscheidt een open source-bedrijf als Nextcloud zich juist door de nadruk te leggen op openheid, selfhosting en ethische controlemechanismen. Ook als we AI toepassen in onze werkprocessen. Deze benadering weerspiegelt niet alleen de waarden van Nextcloud, maar ook de groeiende behoefte aan privacy-vriendelijke technologie, vooral in Europa.

Nextcloud biedt een op open source-principes gebaseerde softwareomgeving voor content collaboration. Daarmee concurreert het Duitse bedrijf dus met techgiganten als Microsoft en Google die eveneens functioneel uitgebreide oplossingen voor contentcreatie en onderlinge samenwerking leveren.

Er is echter een groot verschil: de aandacht voor privacy en ethiek. Waar de techgiganten een niet te stillen honger hebben naar data, profileert Nextcloud zich juist als een aanbieder waar privacybescherming en ethische principes centraal staan. Vandaar ook de focus op selfhosting van de Nextcloud-omgeving: organisaties kunnen Nextcloud op eigen servers draaien en hebben volledige controle over de vraag wat er met data en documenten gebeurt. Maar ook de manier waarop Nextcloud AI-modellen stap voor stap binnen de collaboration-omgeving introduceert en faciliteert is volledig anders.

Groen, geel, oranje en rood

Een belangrijke ontwikkeling binnen Nextcloud is in dat opzicht het zogenoemde stoplichtsysteem voor AI. Dit systeem bestaat inmiddels al enige tijd en dient als een visuele gids voor het beoordelen van de ethische implicaties van verschillende AI-modellen. Daphne Muller, Manager Allianties, Ecosystemen en Support bij Nextcloud en onder andere verantwoordelijk voor de AI-strategie van het bedrijf, legt uit dat het stoplichtsysteem werkt met vier categorieën: groen, geel, oranje, en rood.

Als het AI-model volledig open source is, inclusief de trainingdata, en het model on-premise gebruikt kan worden, krijgt het model de kleur ‘groen’. Indien aan één voorwaarde niet wordt voldaan, krijgt het model ‘geel’. Als aan twee of meerdere voorwaardes niet wordt voldaan, krijgt het model ‘oranje’ of ‘rood’. Als het model geel, oranje, of rood is, kunnen er – afhankelijk van het gebruik en de context – risico’s zijn. Zo is het bijvoorbeeld niet mogelijk om te bestuderen hoe het model precies werkt. Of dat je door het gebruik van zo’n model data kunt lekken.

Het stoplichtsysteem wordt niet alleen gebruikt voor het beoordelen van AI-modellen, maar ook voor het ontwikkelen van nieuwe functies binnen Nextcloud. Elke nieuwe functie of app moet een beoordeling ondergaan. Deze werkwijze heeft ertoe geleid dat Nextcloud een sterke reputatie heeft opgebouwd als een betrouwbare, ethisch verantwoorde keuze voor bedrijven en overheden die privacy en open source-software belangrijk vinden.

Volledige controle voor gebruikers

Een ander belangrijk aspect van Nextcloud’s ethische benadering is de mogelijkheid tot selfhosting. Met andere woorden: de mogelijkheid om de software volledig on-premise te gebruiken. On-premise mag in deze wereld vol cloud services wat ouderwets klinken, maar volgens Muller is dit juist een van de meest waardevolle functies die Nextcloud aanbiedt. Organisaties kunnen alle data en documenten die zij genereren, maar bijvoorbeeld ook AI-modellen volledig in eigen beheer houden – zonder afhankelijk te zijn van externe leveranciers. Dit is interessant voor iedere organisatie die zijn data veilig en privé wil houden, zoals overheidsinstellingen, maar ook een groeiend aantal bedrijven binnen en buiten Europa die werken met gevoelige gegevens.

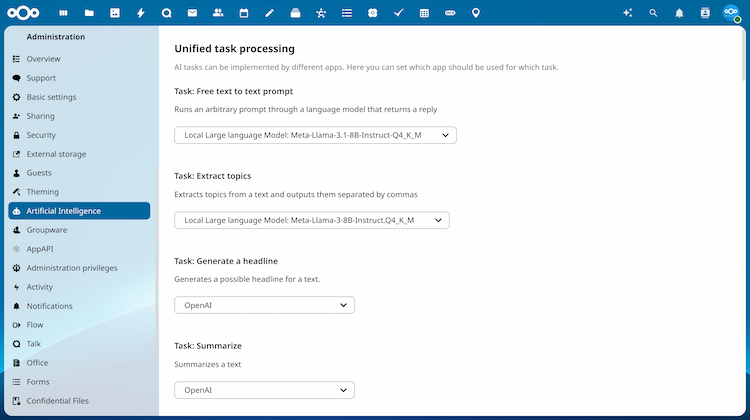

Koppelingen met externe AI-modellen

Nextcloud biedt niet alleen zijn eigen AI-oplossingen aan, maar maakt ook koppelingen mogelijk met externe AI-providers, vertelt Muller. Denk dan aan providers als Plusserver. Ze legt uit dat gebruikers hierdoor klein kunnen beginnen met experimenteren. Als deze experimenten succesvol zijn, kunnen de systemen vervolgens worden uitgebreid. Dit flexibele model van experimenteren met AI is een aantrekkelijke optie voor organisaties die hun AI-mogelijkheden willen verkennen, zonder direct grote investeringen te hoeven doen in complexe infrastructuren. Wil men het gebruik van AI opschalen dan kan men dit zelf faciliteren maar kan men bijvoorbeeld ook een beroep doen op partners van Nextcloud als het genoemde Plusserver, dat een vorm van AI as a Service aanbiedt.

Het vermogen om AI lokaal te draaien en te testen, geeft bedrijven de ruimte om op een veilige manier te experimenteren met nieuwe AI-technologieën, zonder dat ze de controle over hun data kwijtraken. Dit is vooral aantrekkelijk in sectoren waar privacy van groot belang is, zoals de publieke sector in Duitsland. Muller merkte op dat Duitse klanten in het bijzonder waarde hechten aan privacy en open source-oplossingen, veel meer dan bijvoorbeeld in Nederland, waar deze kwesties minder prioriteit lijken te hebben.

Overigens verbaast Muller zich nog wel eens over de in haar ogen zwaar overtrokken eisen die gesteld lijken te worden aan de hardware-systemen die voor AI-gebruik worden ingezet. Zeker als een bedrijf of overheidsorganisatie vooral wil experimenteren, biedt vaak een redelijk standaard server met grafische kaart al voldoende verwerkingscapaciteit. Natuurlijk zal de test dan niet supersnel verlopen, maar dat is bij experimenten ook lang niet altijd nodig. De techgiganten daarentegen lijken soms bewust en vanuit commerciële overwegingen de eisen die gesteld moeten worden aan AI-hardware veel zwaarder voor te stellen. Wil je enorme modellen trainen zoals OpenAI of Google dat doen, heb je uiteraard ook enorme datacenters nodig. Wie echter zelf wil experimenteren met AI-inferencing, kan daar bij wijze van spreken vandaag nog en met eigen hardware mee beginnen.

Transparantie versus ethisch gebruik

Een vraag die rond AI wel eens vergeten lijkt te worden, is of transparantie en openheid in AI automatisch gelijk staat aan ethisch gebruik. Muller is hier duidelijk over. Hoewel open source-principes een belangrijke rol spelen in ethisch verantwoorde technologie biedt het geen universele garantie voor ethisch gebruik. Ook open source AI-modellen kunnen onethisch worden toegepast, afhankelijk van de context en de manier waarop ze worden ingezet. Dit benadrukt in haar ogen de noodzaak van zorgvuldige monitoring en evaluatie, zelfs binnen een transparant systeem zoals Nextcloud’s stoplichtsysteem.

Adoptie van AI

Het gebruik van AI groeit duidelijk – zowel in Europa als daarbuiten. Uit een recente enquête onder de internationale Nextcloud-community bleek dat 54% van de respondenten AI nuttig vindt, en 40% al AI gebruikt in hun dagelijkse werkzaamheden. Dit toont aan dat er zeker interesse is in AI en dat de adoptie ervan gestaag verloopt. Muller benadrukt dat het voor Nextcloud dus belangrijk is om transparante AI-oplossingen te blijven ontwikkelen. Zodat gebruikers zowel de voordelen van AI kunnen benutten als hun privacy en ethiek kunnen blijven waarborgen.

Op de foto bovenaan dit artikel: Nextcloud AI – Assistant ondersteunt nu ook Llama3.