Sinds de lancering van ChatGPT door OpenAI in 2022 hebben bedrijven wereldwijd de mogelijkheden van AI omarmd. Deze modellen worden niet alleen gebruikt voor eenvoudige automatisering, maar ook voor complexe berekeningen. Deze toepassingen brengen een explosieve groei in GPU- en HPC-workloads met zich mee, wat bedrijven dwingt om hun IT-infrastructuur fundamenteel te herzien. Hier komt Infrastructure from Code (IfC) in beeld, een innovatieve benadering die het beheer van cloud-infrastructuur volledig automatiseert vanuit de codebasis.

Wat is Infrastructure from Code (IfC)?

Traditioneel vereist het implementeren van cloud-infrastructuur handmatige configuratie. Developers maken vaak gebruik van tools zoals Terraform of Pulumi, waarbij ze gedetailleerde configuratiebestanden schrijven om servers, databases en andere resources op te zetten. Hoewel deze aanpak effectief kan zijn, is het proces tijdrovend en gevoelig voor menselijke fouten. Bovendien kan een kleine fout in de configuratie leiden tot kostbare problemen, zoals het falen van ML-modeltraining of inefficiënt gebruik van cloud resources.

Infrastructure from Code (IfC) biedt hier een oplossing voor. IfC elimineert de noodzaak van handmatige configuratie door infrastructuurplannen automatisch te genereren vanuit de code zelf. Dit betekent dat ontwikkelaars hun aandacht volledig kunnen richten op het schrijven van applicatiecode, terwijl de infrastructuur zich aanpast aan de eisen van de code.

Belangrijke voordelen van IfC zijn onder andere:

- Automatisering van infrastructuurbeheer: IfC genereert en implementeert automatisch de vereiste cloudresources.

- Schaalbaarheid en flexibiliteit: De infrastructuur kan naadloos meegroeien met de werkdruk, wat cruciaal is voor dynamische workloads.

- Beveiliging en naleving: Met ingebouwde beveiligingsprotocollen, zoals least privilege-toegang, wordt de kans op datalekken en misbruik geminimaliseerd.

IfC heeft zichzelf al bewezen binnen traditionele cloudomgevingen. Echter, de unieke aard van HPC-workloads vereist verdere aanpassing van dit concept.

Wat maakt HPC anders?

High-performance computing onderscheidt zich op meerdere manieren van traditionele cloudcomputing. Waar traditionele cloudapplicaties vaak reactief zijn, zoals bij het afhandelen van API-verzoeken of real-time gebruikersinteracties, zijn HPC-taken veel zwaarder en tijdrovender. Denk hierbij aan het trainen van complexe machine learning-modellen, het renderen van 3D-beelden of het simuleren van wetenschappelijke experimenten.

Deze taken vereisen gespecialiseerde infrastructuur die verder gaat dan de standaard compute-resources:

- Krachtige hardware: HPC-taken maken gebruik van GPU’s, tensor processing units (TPU’s) en andere gespecialiseerde processors om enorme hoeveelheden data te verwerken.

- Razendsnelle opslag: Snelle opslagoplossingen zijn nodig om grote datasets zonder vertraging in en uit het systeem te halen.

- Parallelle verwerking: In plaats van taken sequentieel uit te voeren, worden ze opgesplitst in kleinere jobs die tegelijkertijd worden verwerkt, wat de doorvoersnelheid drastisch verhoogt.

Deze eisen zorgen ervoor dat HPC-workloads vooraf geplande en dedicated resources vereisen. In tegenstelling tot traditionele cloud-omgevingen, waar resources elastisch kunnen worden toegewezen op basis van vraag, moeten HPC-taken van tevoren precies worden geschaald om bottlenecks en vertragingen te voorkomen. Een slecht geplande infrastructuur kan niet alleen de prestaties negatief beïnvloeden, maar ook leiden tot verspilling van tijd en geld.

HPC-infrastructuur en IfC

IfC voor traditionele cloud workloads is voornamelijk gericht op real-time gebeurtenissen, zoals API-verzoeken en message queues. In dergelijke omgevingen kunnen resources elastisch worden geschaald en aangepast aan veranderende behoeften. Maar bij HPC en GPU-intensieve taken ligt de nadruk op batchverwerking en lange rekensessies. Dit vereist een andere aanpak in infrastructuurbeheer.

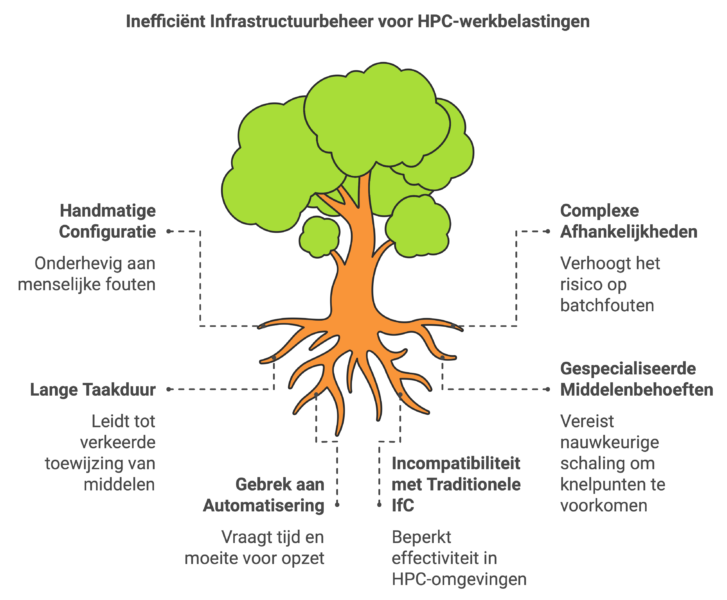

Dit zijn enkele van de specifieke uitdagingen waarmee HPC-ontwikkelaars worden geconfronteerd:

- Batchgebaseerde architecturen: HPC-taken worden vaak uitgevoerd in grote batches die meerdere afhankelijkheden hebben. Een fout in één batch kan invloed hebben op het hele proces.

- Lange looptijden van jobs: In tegenstelling tot kortdurende real-time workloads kunnen HPC-taken uren, dagen of zelfs weken duren.

- Complexe afhankelijkheden: Tijdens ML-training zijn er verschillende fasen zoals data laden, modelinitialisatie en parameter updates die allemaal goed op elkaar moeten aansluiten.

Het handmatig configureren van deze complexe infrastructuur voor elke nieuwe workload is onpraktisch en foutgevoelig. Hier biedt IfC specifiek voor HPC-workloads een oplossing.

De rol van Nitric Batch

Een veelbelovende tools in dit domein is Nitric Batch. Gebouwd op de principes van traditionele IfC, maar geoptimaliseerd voor GPU- en HPC-intensieve workloads, stelt Nitric Batch developers in staat om hun infrastructuur automatisch te beheren en te implementeren.

Met Nitric Batch kunnen zij de volledige infrastructuur configureren zonder handmatige tussenkomst, wat aanzienlijke tijd en moeite bespaart. De tool ondersteunt meerdere programmeertalen zoals Python, Go, NodeJS en Dart, en werkt naadloos samen met cloudplatforms zoals AWS en Google Cloud Platform (GCP).

Belangrijkste functies van Nitric Batch:

- Batchverwerking: Taken kunnen automatisch in parallelle batches worden uitgevoerd, wat de efficiëntie verhoogt.

- Geoptimaliseerde jobbeheer: Complexe fasen in ML-training, zoals lossberekening en backpropagation, kunnen parallel worden uitgevoerd.

- Naadloze integratie: Nitric Batch is compatibel met bestaande IfC-processen, wat betekent dat bedrijven hun traditionele en HPC-workloads in één ecosysteem kunnen beheren.

Met Nitric Batch kunnen teams HPC-taken uitvoeren zonder dat ze zich hoeven te verdiepen in de technische complexiteit van infrastructuurbeheer. Dit stelt hen in staat om zich volledig te concentreren op het verbeteren van hun modellen en toepassingen.

De toekomst van IfC en HPC

De toenemende afhankelijkheid van GPU- en HPC-workloads in de techindustrie benadrukt de noodzaak van geavanceerde infrastructuuroplossingen. Infrastructure from Code (IfC) biedt ontwikkelaars de mogelijkheid om snel, veilig en schaalbaar infrastructuur te implementeren vanuit hun code. Met tools zoals Nitric Batch wordt dit proces uitgebreid naar HPC-workloads, waardoor bedrijven beter kunnen inspelen op de uitdagingen van moderne computing.

Voor organisaties die zich richten op AI, machine learning en andere HPC-toepassingen, biedt de integratie van IfC een aanzienlijke strategische meerwaarde. Het vereenvoudigt niet alleen het implementatieproces, maar verbetert ook de efficiëntie en betrouwbaarheid van complexe workloads.